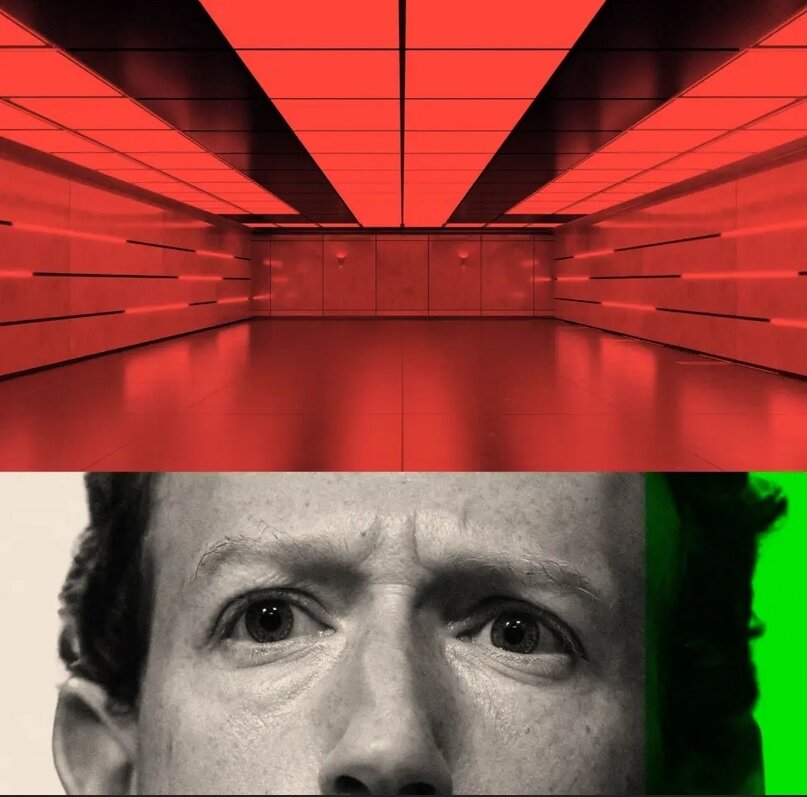

پشتپرده عجیب پناهگاههای آخرالزمانی غولهای فناوری / زاکربرگ و دیگر میلیاردرها از چه میترسند؟

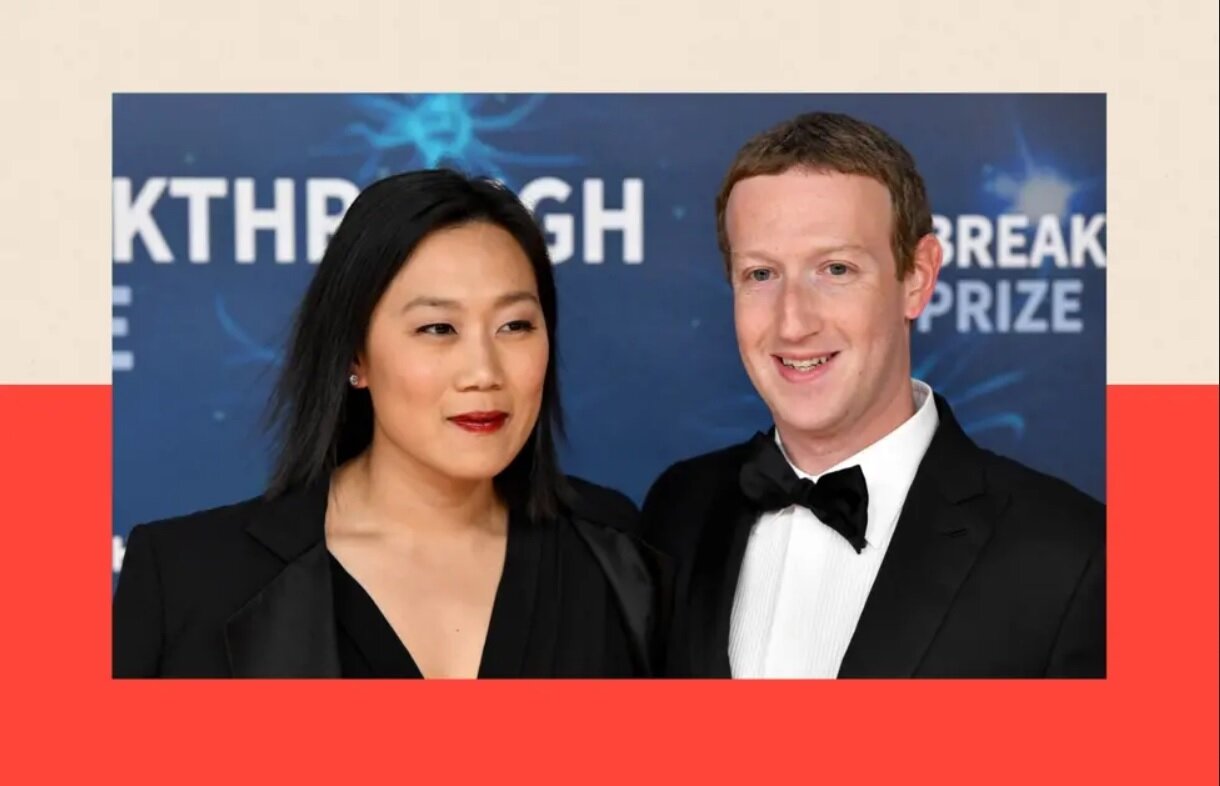

غزال زیاری: گفتهها و شنیدهها حاکی از آن است که مارک زاکربرگ، بنیانگذار سرشناس فیسبوک از سال ۲۰۱۴ در حال ساخت مجموعه عظیمی به نام Koolau Ranch در جزیره کائوآی هاوایی است.

در این مجموعه عظیم علاوه بر تجهیزات و امکانات رفاهی، یک پناهگاه نیز ساختهشده که انرژی و مواد غذایی آن بهصورت مستقل تأمین میشود. دیوار بلندی به ارتفاع دو متر، مانع از آن میشود که افراد از جاده مجاور، به پروژه دید داشته باشند و طبق گزارش مجله Wired، کارکنان این پروژه هم توافقنامههای عدم افشا (NDA) را به امضا رساندهاند تا درباره جزئیات این پروژه صحبتی نکنند.

پارسال وقتی خبرنگاران از زاکربرگ درباره این پروژه از او پرسیدند که آیا در حال ساخت یک پناهگاه آخرالزمانی است یا خیر، او قاطعانه پاسخ داد: «نه» و توضیح داد که فضای زیرزمینی حدوداً ۴۶۵ مترمربعیاش، مثل یک زیرزمین معمولی و شبیه یک پناهگاه کوچک است.

البته حتی این توضیح هم نتوانست مانع از گمانهزنیهای بیشتر شود و تصمیم زاکربرگ برای خرید یازده ملک در پالو آلتوی کالیفرنیا که زیر آن فضای زیرزمینی به مساحت ۶۵۰ مترمربعی اضافهشده هم به هیزم این آتش افزود.

نیویورکتایمز در گزارش خود به این نکته اشارهکرده که گرچه در مجوزهای ساختمانی این ملک، از عنوان “زیرزمین” استفادهشده ولی بعضی از همسایهها ملک زاکربرگ را “پناهگاه” یا حتی “غار بتمنِ میلیاردرها” مینامند. طبق گزارشها، زاکربرگ برای خرید این ملک در محله پالو آلتو، بیش از ۱۱۰ میلیون دلار هزینه کرده است.

راهکارهای اورژانسی دیگر مدیران فناوری

البته او تنها نفری نیست که چنین ملکهای زیرزمینی را خریداری کرده و گمانهزنیهای مختلفی درباره املاک زیرزمینی دیگر مدیران فناوری هم به گوش میرسد: زمینهایی با فضاهای زیرزمینی که پتانسیل تبدیل شدن به پناهگاههای لوکس چند میلیون دلاری را دارند.

رید هافمن، یکی از بنیانگذاران LinkedIn چندی پیش درباره چیزی به نام “بیمه آخرالزمان” صحبت کرد و مدعی شد که حدود نیمی از ابرثروتمندان چنین بیمهای دارند و نیوزیلند مقصد محبوبی برای ساخت خانههای امن آنهاست. حالا این سؤال مطرح میشود که آیا این افراد خود را برای جنگ، تغییرات اقلیمی، یا فاجعهای دیگری که ما از آن خبر نداریم آماده میکنند؟

نگرانیهایی که از آنها بیخبریم

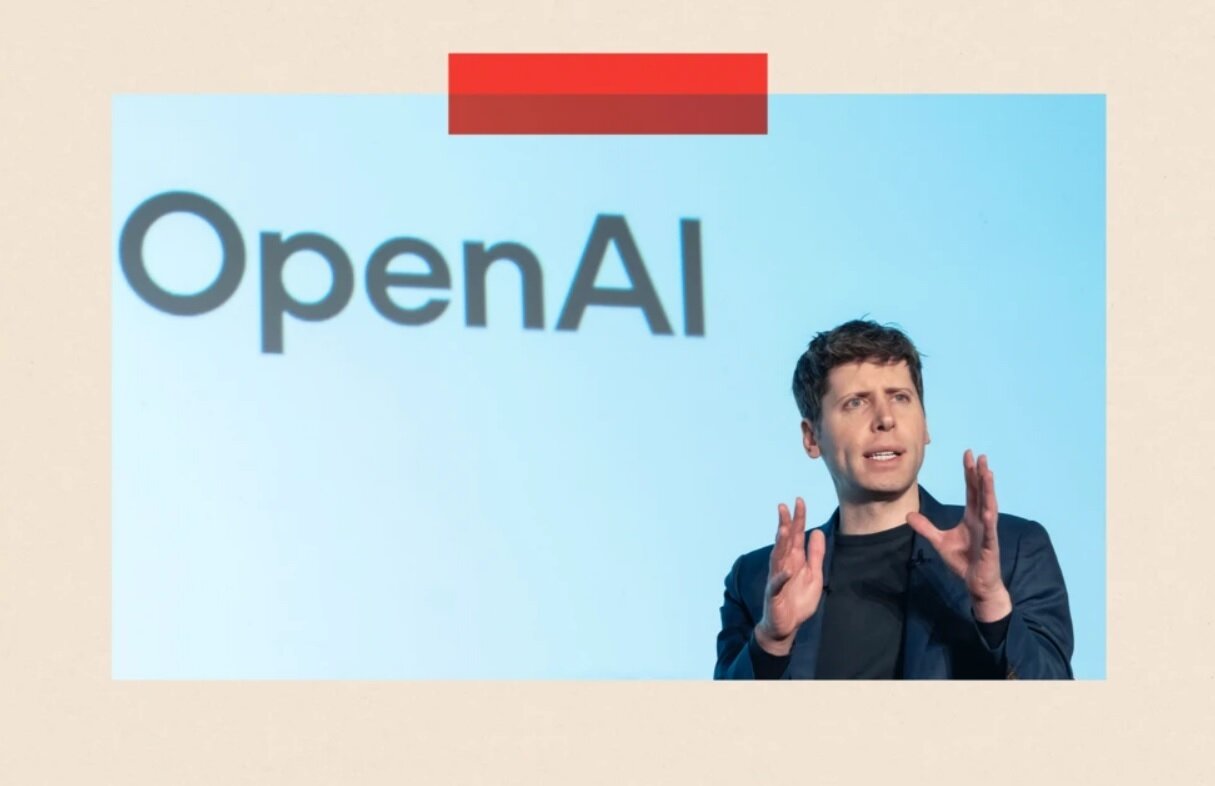

چندی پیش سم آلتمن اعلام کرده بود که در صورت وقوع فاجعه جهانی، ممکن است به پیتر تیل در ملک دورافتادهای در نیوزیلند بپیوندد. در سالهای اخیر، پیشرفت شتابان هوش مصنوعی، نگرانی جدیدی به فهرست نگرانیهای وجودی بشر اضافه کرد و کارشناسان زیادی نسبت بهسرعت رشد این فناوری ابراز نگرانی کردهاند. ایلیا سوتسکِوِر، دانشمند ارشد و یکی از بنیانگذاران OpenAIهم یکی از این افراد است.

در اواسط سال ۲۰۲۳ میلادی بود که انتشار نسخه عمومی ChatGPT حسابی دنیا را به هم ریخت؛ جالب اینجاست که در همان زمان، اعضای این تیم بهسرعت روی نسخههای جدیدتر کار میکرد. کارن هائو، در کتابی در این رابطه، به این موضوع اشاره کرده که در همان تابستان، سوتسکِوِر متقاعد شده بود که دانشمندان کامپیوتر در آستانه توسعه هوش جامع مصنوعی AGI (یعنی لحظهای که ماشینها ازنظر سطح هوش با انسان برابر شوند) هستند.

در یکی از جلسات، او به همکارانش پیشنهاد کرد که پیش از عرضه چنین فناوری قدرتمندی، باید دانشمندان ارشد شرکت به فکر ساخت پناهگاهی زیرزمینی بیفتند. طبق گفته هائو، سوتسکِوِر دراینباره گفته بود: «قبل از اینکه AGI را عرضه کنیم، ما یک پناهگاه خواهیم ساخت.»

البته معلوم نیست که منظور او از “ما” دقیقاً چه کسانی بوده ولی این ماجرا از واقعیت عجیبی خبر میدهد: بسیاری از دانشمندان و مدیران ارشد فناوری که خودشان در حال ساخت پیشرفتهترین شکلهای هوش مصنوعی هستند، بهشدت از آینده آن میترسند.

ظهور هوش عمومی مصنوعی (AGI) و ترس از آینده

حالا این بحث مطرح است که آیا باید واقعا نگران ظهور هوش جامع مصنوعی (AGI) باشیم؟ دراینبین، رهبران فناوری مدعی هستند که AGI بهزودی از راه خواهد رسید. مثلاً سم آلتمن، مدیرعامل OpenAIدر دسامبر سال ۲۰۲۴ گفته بود: «هوش عمومی مصنوعی زودتر از آنچه اکثر مردم فکر میکنند، خواهد آمد.»

دِمیس هسابیس، یکی از بنیانگذارهای DeepMind زمان تحقق آن را بین پنج تا ده سال آینده پیشبینی کرده و داریو آمودِی، بنیانگذار Anthropic پارسال مدعی شده بود که “هوش مصنوعی قدرتمند”، ممکن است تا سال ۲۰۲۶ در دسترس باشد.

از سوی دیگر متخصصان زیادی هم دراینباره مردد هستند. پروفسور وِندی هال از دانشگاه ساوتهمپتون با طعنه در این باره گفته: «آنها مدام هدف را جابهجا میکنند. جامعه علمی میگوید فناوری هوش مصنوعی شگفتانگیز است، اما هنوز بسیار دور از سطح هوش انسانی قرار دارد.»

بابک حجت، مدیر ارشد فناوری شرکت Cognizant هم براین باور است که برای رسیدن به AGI باید چند پیشرفت بنیادی رخ دهد. او معتقد است که تحقق آن احتمالاً بهصورت ناگهانی یا در یک لحظه واحد نخواهد بود؛ چرا که هوش مصنوعی یک فناوری در حال رشد است و شرکتهای متعددی در سراسر جهان برای ساخت نسخههای خود با هم در رقابت هستند.

اما دلیل اصلی این نگرانیها، چیزی فراتر از AGI است؛ ASI یا رؤیای مرحله بعدی فناوری، یعنی هوش فرا انسانی مصنوعی و نوعی فناوری که از هوش انسانی پیشی میگیرد.

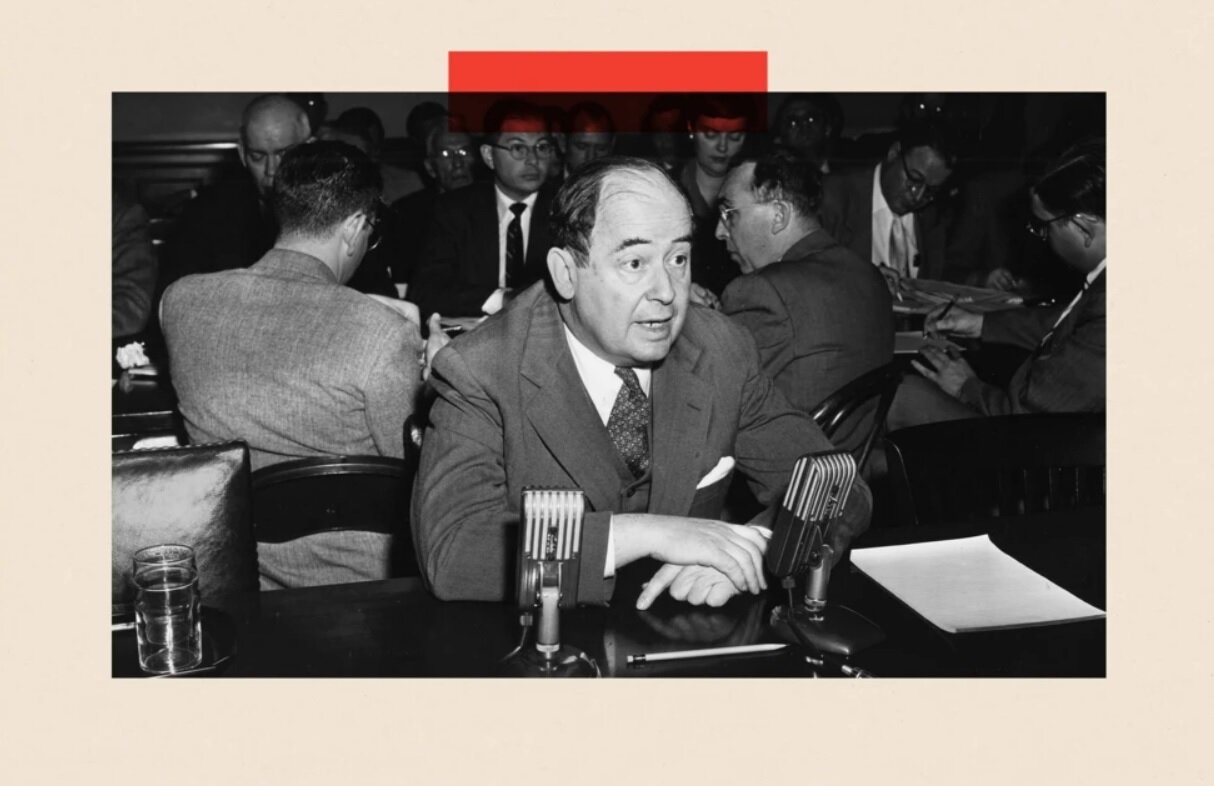

مفهوم تکینگی (Singularity) اولین بار در سال ۱۹۵۸ توسط جان فون نویمان ریاضیدان مجارستانیتبار، مطرح شد و در حقیقت به لحظهای اشاره دارد که هوش ماشینی از درک و کنترل انسان فراتر میرود.

در سال ۲۰۲۴، کتابی با عنوان Genesis نوشته اریک اشمیت، کریگ ماندی و هنری کیسینجر منتشر شد که در آن به بررسی این ایده پرداخته شد که شاید روزی فناوری آنقدر قدرتمند شود که ما تصمیمگیری و رهبری را بهطور کامل به آن واگذار کنیم. استدلال نویسندهها هم این است که این اتفاق قطعاً رخ خواهد داد و فقط این است که چه زمانی شاهد وقوع آن خواهیم بود.

پول برای همه، بدون نیاز به کار؟

طرفداران AGI و ASI دیدگاه نسبتاً دگمی دارند؛ آنان معتقدند که این فناوری قادر است تا درمان بیماریهای کشنده را بیابد، بحران اقلیمی را حل کند و منبع بیپایانی از انرژی پاک ایجاد نماید.

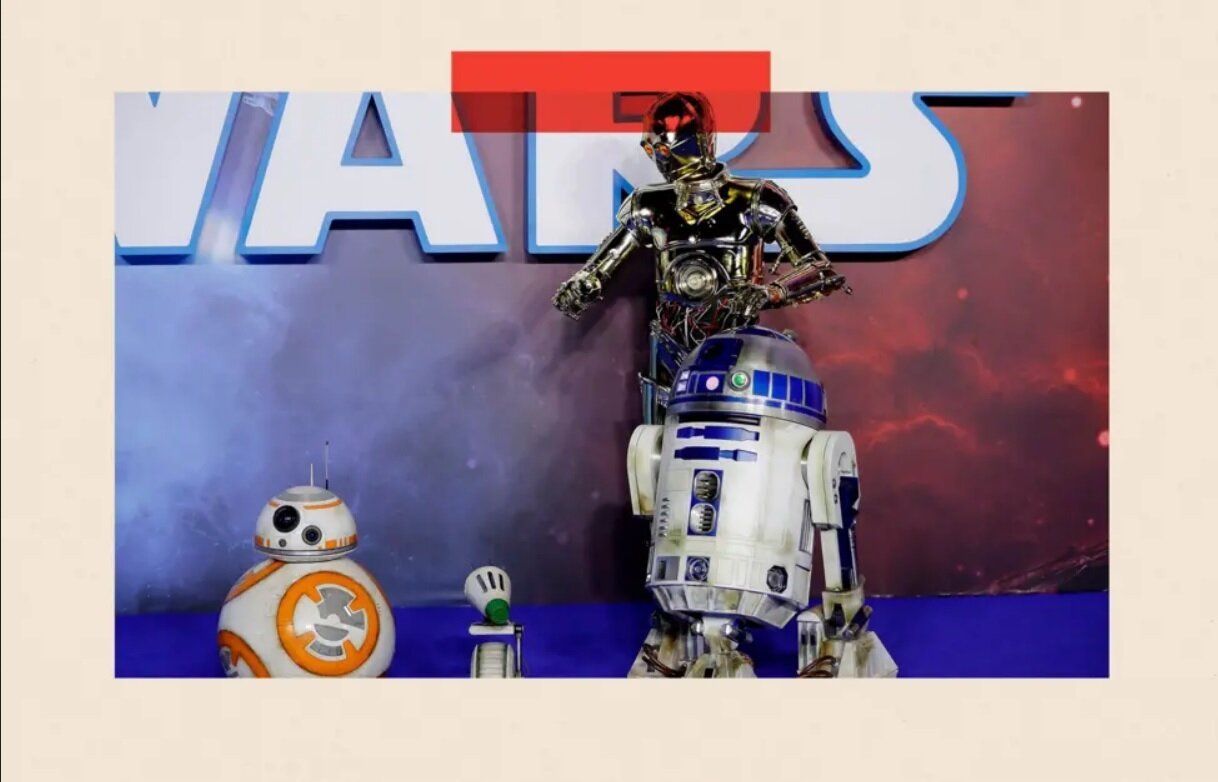

ایلان ماسک حتی مدعی شده که هوش فوقالعاده میتواند دوره درآمد جهانی همگانی را به ارمغان بیاورد. او اخیراً گفته بود که هوش مصنوعی آنقدر ارزان و فراگیر خواهد شد که هر فردی میتواند “یک R۲-D۲ و C-۳PO شخصی” (اشاره به رباتهای فیلم جنگ ستارگان) داشته باشد : «در آن زمان، همه بهترین مراقبتهای پزشکی، غذا، خانه، حملونقل و همه چیزهای دیگر را خواهند داشت. فراوانیِ پایداری در راه است.»

اما این ماجرا یک روی تاریک هم دارد؛ اگر این فناوری به دست تروریستها بیفتد چه خواهد شد؟ یا اگر خود هوش مصنوعی به این نتیجه برسد که انسان، ریشه مشکلات زمین است و تصمیم به حذف ما بگیرد چطور؟

تیم برنرز-لی، خالق وب جهانی، اخیراً در صحبتهایی هشدار داد: «اگر چیزی از شما باهوشتر شود، باید بتوانید آن را مهار کنید و باید بتوانید خاموشش کنید.»

اقدامات دولتها و “بیمه آخرالزمان” ثروتمندان

در این میان، دولتها هم تا حدی برای مقابله با خطرات احتمالی دست به کار شدهاند؛ در آمریکا، جایی که اکثر شرکتهای پیشرو در زمینه هوش مصنوعی در آنجا مستقر هستند، جو بایدن در سال ۲۰۲۳ فرمانی اجرایی صادر کرد که طبق آن، بعضی از شرکتها ملزم به ارائه نتایج آزمایشهای ایمنی خود به دولت فدرال شدند. البته با بازگشت دونالد ترامپ به قدرت، بخشهایی از این دستور به این بهانه که مانعی برای نوآوری هستند، لغو شد.

دو سال پیش بود که مؤسسه ایمنی هوش مصنوعی (AI Safety Institute) که از سوی دولت بریتانیا تأمین مالی میشود، برای بررسی خطرات فناوریهای پیشرفته تأسیس شد.

و در همین میان، میلیاردرهایی هستند که طرحهای خصوصی خود را دنبال میکنند؛ چیزی که رید هافمن آن را “بیمه آخرالزمان” مینامد: «وقتی کسی بگوید که در حال خرید خانهای در نیوزیلند است، درواقع این نوعی اشاره است که نیاز به توضیح ندارد.»

اما در این میان، یک نقص انسانی هم وجود دارد. یکی از محافظان سابق یک میلیاردر که خودش صاحب پناهگاه است، در صحبتهایی به این نکته اشاره کرده که در صورت وقوع فاجعه واقعی، اولین اولویت تیم امنیتی این خواهد بود که با حذف رئیس، خودشان وارد پناهگاه شوند و به نظر میرسید شوخی هم نمیکند.

آیا این نگرانیها فقط توهم هستند؟

پروفسور نیل لارنس، متخصص یادگیری ماشین در دانشگاه کمبریج، معتقد است که در این بحثها بیش از حد بزرگنمایی شده است: «مفهوم هوش عمومی مصنوعی (AGI) به اندازهٔ مفهوم “وسیله نقلیه عمومی مصنوعی” پوچ است!»

طبق استدلال او، همانطور که هیچ وسیلهای وجود ندارد که بتواند همزمان نقش هواپیما، خودرو و دوچرخه را بازی کند، هیچ هوشی هم وجود نخواهد داشت که در تمام زمینهها معادل انسان باشد: «فناوریای که در حال حاضر ساختهایم، برای اولین بار در تاریخ، به مردم عادی این امکان را میدهد که مستقیماً با ماشین صحبت کنند و از آن بخواهند کاری را برایشان انجام دهد. این خودش بهشدت تحولبرانگیز است؛ اما نگرانی من این است که آنقدر درگیر روایتهای شرکتهای بزرگ دربارهٔ AGI شدهایم که فراموش میکنیم چطور همین فناوریهای فعلی را باید به نفع مردم بهبود دهیم.»

مغز انسان در برابر هوش مصنوعی

با وجودی که هوش مصنوعی در بعضی زمینهها مثل تحلیل داده و تشخیص الگو، از مغز انسان پیشی گرفته، اما از نظر ساختار زیستی و درک آگاهانه، هنوز فاصله زیادی با مغز انسان دارد.

مغز انسان حدود ۸۶ میلیارد نورون و ۶۰۰ تریلیون سیناپس دارد که این به مراتب بیشتر از هر مدل مصنوعی موجود دیگری است. یک مدل زبانی بزرگ (LLM) باید بین تعاملها مکث کند؛ ولی مغز انسان دائماً در حال یادگیری و سازگاری است.

بابک حجّت در این رابطه توضیح داد: «اگر به انسان بگویید روی یک سیاره دوردست حیات کشف شده، او بلافاصله این اطلاعات را میپذیرد و درک خودش از جهان را تغییر میدهد؛ اما یک مدل زبانی تنها تا زمانی این را میداند که شما مدام به او یادآوری کنید. مدلهای زبانی فاقد فراشناخت هستند؛ یعنی نمیدانند که چه میدانند؛ اما انسانها نوعی ظرفیت دروننگرانه دارند، چیزی که گاهی “آگاهی” نامیده میشود و این همان چیزی است که هنوز در هیچ آزمایشگاهی بازتولید نشده است.»

در نهایت، فناوری هوش مصنوعی هرچقدر هم قدرتمند شود، هنوز هم بدون احساس، نیت یا درک واقعی از جهان در محدوده دادهها و الگوریتمهایش عمل میکند؛ از سوی دیگر انسانها دارای آگاهی، اخلاق و شهود هستند و این ویژگیهایی است که تا امروز هیچ ماشینی به آن نزدیک هم نشده است.

با وجود این، ترس میلیاردرهای سیلیکونولی از آینده، بیدلیل نیست. پیشرفت سریع فناوری، خطرهای واقعی متعددی هم دارد: از دستکاری اطلاعات تا وابستگی بیش از حد جوامع به سیستمهایی که هیچکس واقعاً آنها را نمیفهمد.

شاید در این شرایط باید به هشدار نیل لارنس بیشتر توجه کرد: «بزرگترین خطر، شاید نه از ماشینها، بلکه از انسانهایی است که قدرت را به ماشینها میسپارند.»

منبع: BBC

۵۸۳۲۱

لینک خبر